Meta, la empresa fundada por Mark Zuckerberg, ha presentado su último modelo de inteligencia artificial (IA) llamado ImageBind. Esta innovadora IA está diseñada para aprender de la misma manera que los seres humanos, utilizando un enfoque multisensorial que combina imágenes, texto, video y audio, así como también datos de profundidad, térmicos y de inercia.

Lo que hace que ImageBind sea único en comparación con otras IA es su capacidad para vincular seis tipos diferentes de datos en un índice multidimensional, lo que significa que puede aprender de diversas fuentes de entrada. Por ejemplo, los usuarios podrán usar cualquiera de estos seis tipos de datos como método de entrada o realizar una referencia cruzada de ellos.

ImageBind: la revolucionaria IA de Meta inspirada en el cerebro humano

El objetivo de ImageBind, es predecir conexiones entre datos de manera similar a cómo lo hacemos los humanos cuando imaginamos un entorno. Esta herramienta es diferente a otras IA que generan imágenes como Midjourney, Stable Diffusion y DALL-E 2. Estas últimas solo emparejan palabras con imágenes para generar escenas visuales basadas en una descripción de texto.

ImageBind es más avanzado, ya que puede vincular diferentes tipos de datos como texto, imágenes/videos, audio, mediciones 3D (profundidad), datos de temperatura (térmicos) y datos de movimiento (de unidades de medición inerciales). Además, lo hace sin tener que ser entrenado con anticipación en cada posible combinación.

ImageBind se encuentra en sus primeras etapas, pero en el futuro podría generar entornos complejos a partir de una entrada tan simple como un mensaje de texto, una imagen o una grabación de audio, o incluso una combinación de los tres. ¡Es emocionante pensar en las posibilidades!

ImageBind aprende como un humano

Una de las cosas interesantes de ImageBind es que funciona de forma similar al aprendizaje humano. «Cuando los humanos aprendemos cosas del mundo que nos rodea, utilizamos nuestros sentidos de forma natural y simultánea«, explica Meta. De hecho, los seres humanos podemos incluso imaginar experiencias sensoriales al ver una imagen, como la foto de un paisaje.

Imagina que estás parado en una calle concurrida de la ciudad. Tu cerebro (incluso de manera inconsciente) absorbe imágenes, sonidos y otras experiencias sensoriales para entender lo que está pasando a tu alrededor, como los autos y peatones que pasan, los edificios altos, el clima y mucho más. Los humanos y otros animales evolucionaron para procesar estos datos para nuestra ventaja genética, como la supervivencia y transmisión de nuestro ADN.

Una de las principales limitaciones de las IA es que todavía no puede entender la información sensorial de la misma manera que los seres humanos. Pero eso parece que puede cambiar con ImageBind, que vincula los diferentes tipos de datos para generar escenas de manera más avanzada que otras herramientas similares.

No hay límites para ImageBind

Si bien es cierto que Midjourney puede crear una imagen de «un gato siamés con un traje de bufón mientras se balancea sobre una pelota de playa«, ImageBind puede hacer algo aún más impresionante. Puede crear videos de esa escena con sonidos reales y detalles como una sala de estar suburbana detallada, la temperatura de la habitación y las ubicaciones precisas de los objetos y personas en la escena.

“Esto crea oportunidades distintivas para crear animaciones a partir de imágenes estáticas combinándolas con indicaciones de audio”, dijeron hoy los investigadores de Meta en una publicación de blog centrada en los desarrolladores. “Por ejemplo, un creador podría acoplar una imagen con un despertador y el canto de un gallo, y usar un mensaje de audio de canto para segmentar el gallo o el sonido de una alarma para segmentar el reloj y animar ambos en una secuencia de video”.

¿Te imaginas las posibilidades creativas que esto abre? ¡Puedes crear animaciones increíbles a partir de imágenes estáticas! Los investigadores de Meta, parecen sugerir que esta herramienta podría ser utilizada en el futuro para crear películas enteras a partir de imágenes estáticas.

¿Cómo evolucionará ImageBind?

En el futuro, podríamos ver nuevas características y mejoras en la herramienta, lo que permitiría crear aún más experiencias inmersivas y realistas. Lo más interesante de ImageBind es que podría ayudar a mejorar la realidad virtual, la realidad mixta y el metaverso.

Por ejemplo, en el futuro, podrías crear escenas 3D increíblemente detalladas (con sonido, movimiento y más) sobre la marcha. En este sentido, los desarrolladores de juegos virtuales podrían usar ImageBind para reducir el tiempo y el esfuerzo necesarios en el proceso de diseño.

Incluso, los creadores de contenido podrían hacer videos inmersivos con paisajes sonoros y movimientos realistas, basados solo en la entrada de texto, imagen o audio. También es emocionante pensar en cómo ImageBind podría ayudar a las personas con discapacidades visuales o auditivas a percibir mejor su entorno inmediato al generar descripciones multimedia en tiempo real.

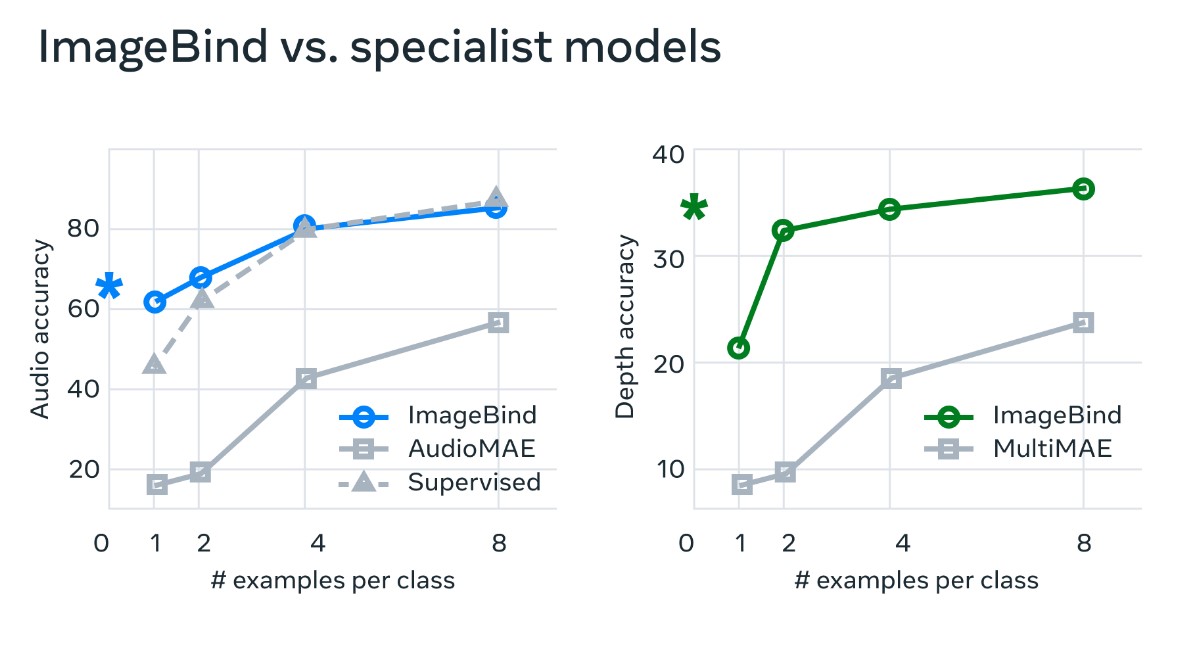

“En los sistemas típicos de IA, hay una incrustación específica (es decir, vectores de números que pueden representar datos y sus relaciones en el aprendizaje automático) para cada modalidad respectiva”, dijo Meta. “ImageBind muestra que es posible crear un espacio de incorporación conjunto a través de múltiples modalidades, sin necesidad de capacitarse en datos con cada combinación diferente de modalidades.”

Meta busca expandir los límites de la IA más allá de los sentidos humanos conocidos

Meta considera que la tecnología eventualmente se expandirá más allá de sus seis «sentidos» actuales, por así decirlo. “Si bien exploramos seis modalidades en nuestra investigación actual, creemos que la introducción de nuevas modalidades que vinculan tantos sentidos como sea posible, como el tacto, el habla, el olfato y las señales de resonancia magnética funcional del cerebro, permitirán crear modelos de IA más ricos, centrados en el ser humano”.

Además, Meta ha anunciado que ImageBind será de código abierto, lo que significa que los interesados podrán acceder al repositorio en GitHub. Los desarrolladores interesados en explorar este nuevo entorno limitado pueden comenzar sumergiéndose en el código fuente abierto de Meta.

Es increíble lo que la tecnología de inteligencia artificial puede lograr hoy en día. ¿Qué piensas? ¿Te gustaría probar ImageBind y ver lo que puedes crear con ella?

Fuente | Meta AI